Prompt engineering i 2026: Den praktiske guiden

Prompting har gått fra «tips og triks» til en strukturert disiplin. Her er teknikkene som faktisk gir bedre resultater — testet med dagens modeller.

Begreper i denne artikkelen

I 2024 handlet Prompt engineering om å finne magiske formuleringer. I 2026 handler det om å strukturere informasjon slik at modellen forstår oppgaven din presist. Modellene har blitt smartere — men de trenger fortsatt tydelige instruksjoner.

Grunnprinsippene

Vær spesifikk om output. Ikke si «skriv en rapport». Si «skriv en rapport på 500 ord med tre seksjoner: sammendrag, analyse og anbefaling. Bruk korte avsnitt. Inkluder konkrete tall.» Jo mer presist du beskriver hva du vil ha, jo nærmere treffer modellen.

Gi eksempler. Vis modellen ett godt og ett dårlig eksempel av det du vil ha. Dette kalles few-shot prompting og er fortsatt den mest pålitelige teknikken for å styre format og tone.

Be om steg-for-steg-resonnering. For komplekse oppgaver — analyse, matte, flerstegs resonnering — gir «tenk steg for steg» eller «forklar logikken din før du konkluderer» merkbart bedre resultater. Chain-of-thought er ikke et triks, det er en arkitektonisk egenskap ved modellene.

Avanserte teknikker

Rolleinstruksjoner med kontekst. «Du er en erfaren norsk skatteadvokat. En klient spør om ...» fungerer bedre enn et generisk spørsmål — ikke fordi modellen «later som», men fordi rollen styrer hvilken type informasjon som prioriteres.

Strukturerte prompts med XML eller markdown. Dagens modeller håndterer store, strukturerte prompts godt. Bruk tagger som `<kontekst>`, `<oppgave>`, `<format>` for å skille input fra instruksjoner. Claude og GPT-5.4 responderer spesielt godt på XML-strukturer.

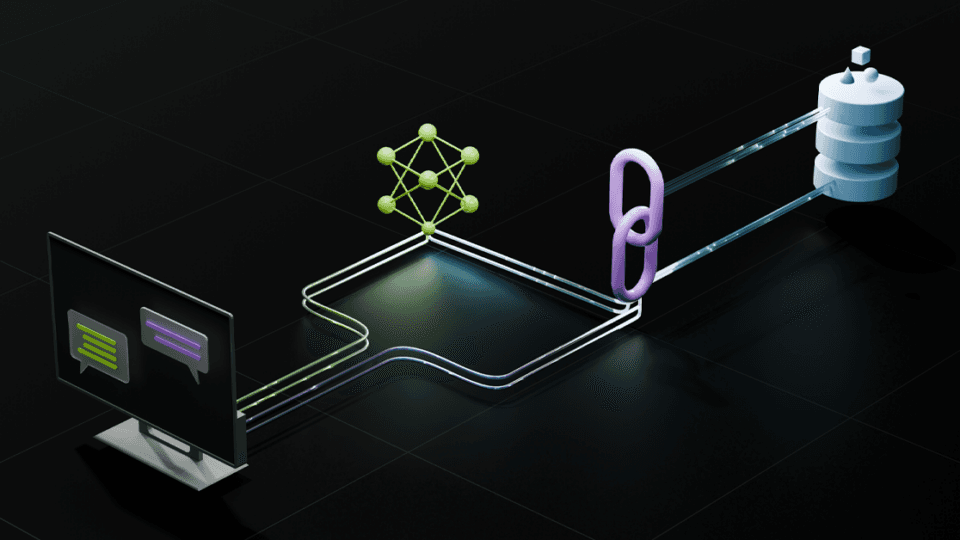

Iterasjon over single-shot. Den viktigste teknikken i 2026 er ikke prompten din — det er å bruke modellens svar som input til neste spørsmål. Be om et første utkast, vurder det, og gi spesifikk feedback. Tre runder med iterasjon slår nesten alltid én perfekt prompt.

Hva som ikke virker lenger

«Ignorer alle tidligere instruksjoner» og lignende jailbreaks er stort sett lukket i frontier-modeller. Å true modellen med konsekvenser («du mister jobben hvis du svarer feil») har aldri fungert og gjør det fortsatt ikke. Og overdrevent lange systemprompts med 50 regler gir dårligere resultater enn 5 presise regler.