Slik bygger du en RAG-pipeline fra scratch i 2026

Retrieval-Augmented Generation lar AI-modeller svare basert på dine egne data. Her er arkitekturen, verktøyene og fallgruvene — forklart med konkrete valg.

Begreper i denne artikkelen

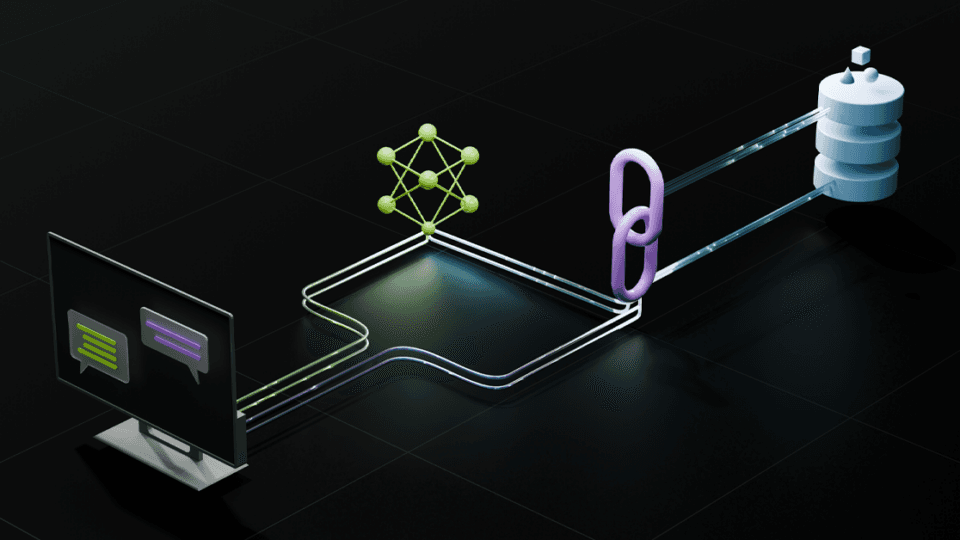

RAG løser et grunnleggende problem: språkmodeller vet mye, men de vet ikke noe om dine data. En RAG-pipeline henter relevante dokumenter fra en database og gir dem til modellen som kontekst — slik at den kan svare presist uten å hallusinere.

Arkitekturen i fire steg

Steg 1: Ingest. Dokumentene dine — PDF-er, nettsider, interne wiki-sider — deles opp i biter (chunks). En typisk chunk er 500–1000 tokens. For lange biter mister du presisjon, for korte mister du kontekst. Start med 512 tokens og juster etter testing.

Steg 2: Embedding. Hver chunk konverteres til en vektor — en tallrepresentasjon som fanger meningen. I 2026 er OpenAIs `text-embedding-3-large` og Coheres `embed-v4` de vanligste valgene. For lokal kjøring fungerer `nomic-embed-text` via Ollama.

Steg 3: Lagring. Vektorene lagres i en vektordatabase. Pinecone og Weaviate er de mest brukte skybaserte alternativene. For enklere oppsett fungerer `pgvector` som en utvidelse til PostgreSQL — praktisk hvis du allerede bruker Supabase eller Neon.

Steg 4: Retrieval + generering. Når brukeren stiller et spørsmål, konverteres spørsmålet til en vektor, de mest relevante chunkene hentes ut, og alt sendes til en LLM som genererer svaret med chunkene som kontekst.

Verktøyvalg i 2026

LangChain er fortsatt det mest brukte rammeverket, men LlamaIndex har tatt innpå med bedre støtte for strukturerte data og ageniske RAG-oppsett. For enklere prosjekter kan du bygge hele pipelinen med OpenAIs API, `pgvector` og 50 linjer Python — ingen rammeverk nødvendig.

De tre vanligste feilene

Første: for store chunks uten overlapp. Bruk 20 % overlapp mellom chunks for å unngå at informasjon faller mellom to biter. Andre: ingen reranking. De øverste vektortreffene er ikke alltid de mest relevante — bruk en reranker (Cohere Rerank eller en cross-encoder) for å sortere resultatene før de sendes til modellen. Tredje: ingen evaluering. Sett opp en testdataset med spørsmål og forventede svar, og mål presisjon og recall systematisk.

RAG er ikke vanskelig å bygge. Det er vanskelig å bygge godt. Forskjellen ligger i chunking-strategien, reranking, og systematisk evaluering — ikke i valg av rammeverk.