I juli 2025 signerte Anthropic en kontrakt med Pentagon verdt 200 millioner dollar. Selskapet ble det første AI-laboratoriet som deployerte sine modeller på det amerikanske forsvarets klassifiserte nettverk. Åtte måneder senere lå de i retten mot den samme kunden.

Mellomperioden handler om to røde linjer, en presidentordre skrevet i store bokstaver, og et juridisk prinsipp som kan endre maktbalansen mellom AI-selskaper og stater permanent.

Fra forhandlingsbord til rettsal

Kontrakten fungerte. Claude ble brukt på tvers av Pentagon, og Anthropic ble hyllet som en pålitelig partner. Men da forhandlingene om deployment på GenAI.mil — Pentagons nye AI-plattform — startet i september 2025, kolliderte to verdensbilder.

Pentagon krevde ubegrenset tilgang til Claude for «alle lovlige formål». Anthropic insisterte på to røde linjer: modellen skulle ikke brukes til autonome våpen uten menneskelig tilsyn, og den skulle ikke brukes til masseovervåking av amerikanske borgere. CEO Dario Amodei har gjentatte ganger argumentert for at teknologien ikke er moden nok til å brukes trygt i disse scenariene.

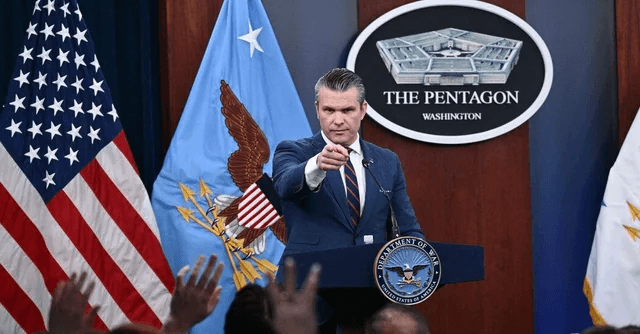

Forhandlingene stoppet opp. I februar 2026 eskalerte konflikten raskt. Forsvarsminister Pete Hegseth kalte Anthropic «arrogant» og skrev på X at selskapet hadde levert «en masterklasse i arroganse og svik». President Trump fulgte opp med en Truth Social-post i store bokstaver: «WE will decide the fate of our Country — NOT some out-of-control, Radical Left AI company.» Han beordret alle føderale etater til umiddelbart å avslutte all bruk av Anthropics teknologi.

Så tok Pentagon det mest dramatiske steget: de stemplet Anthropic som en «supply chain risk» — en sikkerhetsrisiko i forsyningskjeden. Denne betegnelsen har historisk vært forbeholdt selskaper knyttet til utenlandske motstandere. Konsekvensen: enhver bedrift som gjør forretninger med det amerikanske forsvaret måtte bevise at de ikke brukte Anthropics produkter. Det var ikke et kontraktsopphør — det var et forsøk på å isolere selskapet fra hele det amerikanske forsvarsindustrielle komplekset.

Timer etter at Anthropic ble svartelistet, annonserte OpenAI at de hadde inngått en avtale med Pentagon om å ta over. Flere OpenAI-ansatte sa opp i protest.

Dommerens kjennelse

Anthropic saksøkte 9. mars. Rettshøringen fant sted 24. mars. To dager senere leverte dommer Rita Lin i den føderale distriktsdomstolen i San Francisco en 43 sider lang kjennelse som ikke etterlot mye rom for tvil.

«Ingenting i den gjeldende loven støtter den orwellske forestillingen om at et amerikansk selskap kan stemples som en potensiell motstander og sabotør av USA for å ha uttrykt uenighet med myndighetene,» skrev Lin.

Hun blokkerte både Pentagons supply chain risk-stempel og Trumps presidentordre. Begrunnelsen var trefoldig: Anthropics rettigheter under First Amendment var sannsynligvis krenket. Selskapets rettssikkerhet under Fifth Amendment var sannsynligvis brutt — de fikk aldri mulighet til å bestride stempelet. Og Pentagons handlinger var «vilkårlige og urimelige» — Lin pekte på at interne dokumenter viste hjertelig e-postkorrespondanse mellom Pentagons teknologisjef Emil Michael og Amodei, selv mens forsvaret offentlig kalte Anthropic en alvorlig trussel.

«Disse brede tiltakene ser ikke ut til å være rettet mot myndighetenes uttalte nasjonale sikkerhetsinteresser,» skrev Lin. «Hvis bekymringen er integriteten i den operasjonelle kommandokjeden, kunne forsvarsdepartementet bare slutte å bruke Claude. I stedet ser disse tiltakene ut til å være designet for å straffe Anthropic.»

Domstolen presiserte: dette handler ikke om å tvinge Pentagon til å bruke Claude. Pentagon kan velge hvilken AI-leverandør de vil. Men de kan ikke svarteliste et amerikansk selskap som en nasjonal sikkerhetstrussel fordi selskapet offentlig kritiserte kontraktsvilkårene.

Bransjens reaksjon

Støtten til Anthropic kom fra uventede hold. Over 30 ansatte fra OpenAI og Google DeepMind — inkludert Googles AI-forskningssjef Jeff Dean — leverte en støtteerklæring i retten. Microsoft, som er OpenAIs største investor, sendte sin egen. ACLU, Cato Institute, pensjonerte militære ledere og en gruppe katolske teologer sendte alle amicus-innlegg.

Patrick Moorhead, sjef i Moor Insights & Strategy, oppsummerte dynamikken for Axios: «OpenAI så opportunistisk ut. Anthropic ble svartelistet. Google vant mest terreng uten at noen snakker om det.» Google annonserte stille at de ville levere AI-agenter til Pentagons 3 millioner ansatte — dagen etter at Anthropic saksøkte.

Historien gjentar seg — nesten

Det finnes en direkte forløper: Google og Project Maven i 2018. Pentagon brukte Googles AI-modeller til å analysere dronebilder og identifisere potensielle mål. Tusenvis av Google-ansatte protesterte. Flere sa opp. Google trakk seg fra kontrakten.

Men parallellen har en grense. Google trakk seg frivillig. Anthropic trakk seg ikke — de forsøkte å forhandle begrensninger, og ble straffet for det. Det er en kvalitativ forskjell. I 2018 handlet debatten om et selskap burde jobbe med militæret overhodet. I 2026 handler den om på hvilke vilkår.

Antropics posisjon er mer nyansert enn Googles var. Selskapet sier de vil fortsette å betjene Pentagon under pågående militære operasjoner. De sier de støtter bruk av AI for nasjonal sikkerhet. De bare mener at teknologien ikke er moden nok til å treffe autonome dødelige beslutninger eller overvåke amerikanske borgere i stor skala uten menneskelig kontroll.

Det vanskelige spørsmålet

Saken reiser et spørsmål som ingen i AI-bransjen kan unngå i 2026: Hvem bestemmer hva AI brukes til?

Pentagons argument er intuitivt: myndighetene skal bestemme hvordan verktøyene de kjøper brukes, ikke leverandøren. Emil Michael formulerte det slik: «Vi kan ikke ha et selskap med en annen policy-preferanse bakt inn i modellen ... som forurenser forsyningskjeden slik at krigerne våre får ineffektive våpen.»

Anthropics argument er like intuitivt: et selskap har rett til å sette vilkår for produktene sine, spesielt når teknologien opererer i et grenseområde der feil kan være katastrofale. Og de har rett til å si det offentlig uten å bli straffet.

Dommer Lins kjennelse gir foreløpig Anthropic rett i det juridiske spørsmålet. Men det politiske spørsmålet er langt fra avgjort. Pentagon har én uke til å anke. En parallell sak pågår i en appelldomstol i Washington, D.C.

Hva dette betyr videre

Det er fristende å lese denne saken som en AI-spesifikk konflikt. Det er den ikke. Det er en sak om forholdet mellom staten og private teknologiselskaper — et tema som har preget amerikansk politikk siden AT&T-monopolet og som nå tar en helt ny form.

Jennifer Huddleston, senior fellow ved Cato Institute, sa til NPR at kjennelsen har implikasjoner langt utenfor denne saken. Hvis myndighetene kan stemple innenlandske leverandører som sikkerhetstrusler fordi de kritiserer offentlige innkjøpsvilkår, vil det ha en nedkjølingseffekt på legitim teknisk debatt om AI-sikkerhet, personvern og produktegenskaper i hele bransjen.

Anthropics egne rettsdokumenter avslørte at supply chain risk-stempelet allerede truer hundrevis av millioner dollar i forventede inntekter og kan koste selskapet milliarder. Stempelet fikk kunder til å omvurdere kontrakter og føderale etater til å avvikle Claude innen dager.

Paradokset er påfallende: det eneste AI-selskapet som satte etiske grenser for militær bruk, ble straffet. Det selskapet som tok over kontrakten uten de samme grensene, ble belønnet. For AI-selskaper som vurderer sine egne røde linjer, er signalet utvetydig — med mindre domstolene opprettholder prinsippet Lin har etablert.

Saken er ikke avgjort. Kjennelsen er foreløpig. Ankemulighetene er åpne. Men prinsippet dommer Lin har formulert — at et amerikansk selskap ikke kan stemples som en nasjonal sikkerhetstrussel for å ha ytret uenighet med myndighetene — er det viktigste AI-rettslige utsagnet i 2026. Kanskje i dette tiåret.